MUM, le nouvel algorithme de Google

La firme de Mountain View réalise des mises à jour et lance régulièrement de nouvelles fonctionnalités. Ce qui implique des changements variables. Google ne les explique pas toujours. MUM a été présenté au public par son Vice-Président, Pandu Nayak, en mai 2021. Ce modèle de langage serait 1000 fois plus puissant que BERT, qui est un de ses prédécesseurs. Il permettra au moteur de recherche de répondre aux requêtes complexes pour lesquelles une réponse directe n’est pas possible.

Avant le nouvel algorithme MUM de Google : BERT

BERT est l’acronyme pour Bidirectional Encoder Representations from Transformers. Il s’agit d’un modèle de langage pur, ayant été créé d’une manière tout à fait novatrice. Google le définit comme une technique basée sur un réseau neural pour le préentraînement au Traitement automatique du Langage Naturel (NLP : Natural Language Processing). Ce dernier combine intelligence artificielle, linguistique et informatique. On insiste sur la notion de préentraînement, car si BERT constituait alors une base, MUM s’inscrit dans son prolongement.

Au lieu d’alimenter BERT avec des exemples de textes et leur signification, les chercheurs lui assimilèrent une énorme quantité d’informations non définies. Il s’agissait d’un contenu supérieur à 10 000 livres numérisés et à 2,5 milliards de mots provenant de Wikipedia. Ils ont ensuite masqué certains mots et laissé le réseau neural remplir les vides. À force d’analyser le contenu qui lui a été fourni, BERT a identifié certaines structures de mots et de phrases identiques, dans un contexte similaire. Cela lui a permis de comprendre des relations primaires entre certains mots.

La mise en place de BERT répondait à trois enjeux majeurs. 15% des requêtes dans Google sont inédites, étant donné que le moteur ne les a jamais rencontrées auparavant. Son algorithme doit alors identifier les résultats les plus pertinents dans son index.

Avec la recherche vocale, les internautes ne s’attendent plus à des résultats, mais à des réponses. Ainsi, il fallait que le moteur soit parfaitement capable de comprendre les requêtes pour pouvoir apporter les meilleures réponses.

BERT répond également à la tendance des requêtes qui se font de plus en plus longues. Si auparavant quelques mots suffisaient, nous utilisons désormais plus de requêtes supérieures à 4 mots. Les questions deviennent également plus courantes, dues aux nombres de recherches vocales. La compréhension de la sémantique est essentielle pour comprendre une longue requête.

BERT mis en place en 2019 a révolutionné le fonctionnement du moteur de recherche. L’algorithme de Google utilise dorénavant l’IA et le Machine Learning pour comprendre la manière dont les mots sont reliés entre eux dans une requête, au lieu d’examiner chacun des termes de manière individuelle.

Suite à une requête, la méthode de sélection des réponses de Google repose dorénavant sur un mélange de recherche sémantique et de recherche par terme. Le moteur fonctionne sur la base suivante : indexation, recherche puis classement. Il n’est alors plus possible d’utiliser les mêmes astuces pour tromper Google à des fins de référencement. La seule solution afin d’être correctement indexé est de produire du contenu qui répond aux questions posées ou qui correspond aux besoins de l’audience.

MUM : le futur de Google

MUM (Multitask Unified Model) a été présenté lors de la conférence annuelle Google I/O. Il s’agit d’un modèle de langage – au même titre que GPT-3 ou LaMDA – basé sur BERT. Il devrait radicalement changer l’expérience utilisateur. MUM utilise l’intelligence artificielle pour comprendre et répondre à des requêtes « complexes ». Par complexe, entendez « multicouches ». Ce genre de requête nécessite plusieurs étapes de recherche et d’analyse avant d’aboutir à une réponse satisfaisante.

Comme BERT, il repose sur une architecture open source Transformer, un réseau neuronal récurrent ou RNN. Ce système s’enrichit en permanence grâce aux connaissances qu’il analyse. Il vise à renforcer les capacités des moteurs de recherche. Par contre, MUM fait évoluer la recherche au-delà des requêtes contextuelles de BERT. Il étend également sa capacité à comprendre le langage et le contexte.

En guise d’illustration, Prabhakar Raghavan (Senior Vice-Président de Google) a pris l’exemple d’une requête complexe adressée plutôt à un expert qu’à un moteur de recherche. En imaginant que vous aviez escaladé le mont Adams, vous demandez à Google comment vous préparer pour le mont Fuji l’automne prochain. Grâce à MUM, Google pourra bientôt fractionner cette requête en plusieurs variables (température, conditions météo, altitude, type de terrain, etc.) et comparer les résultats obtenus pour en extraire une réponse.

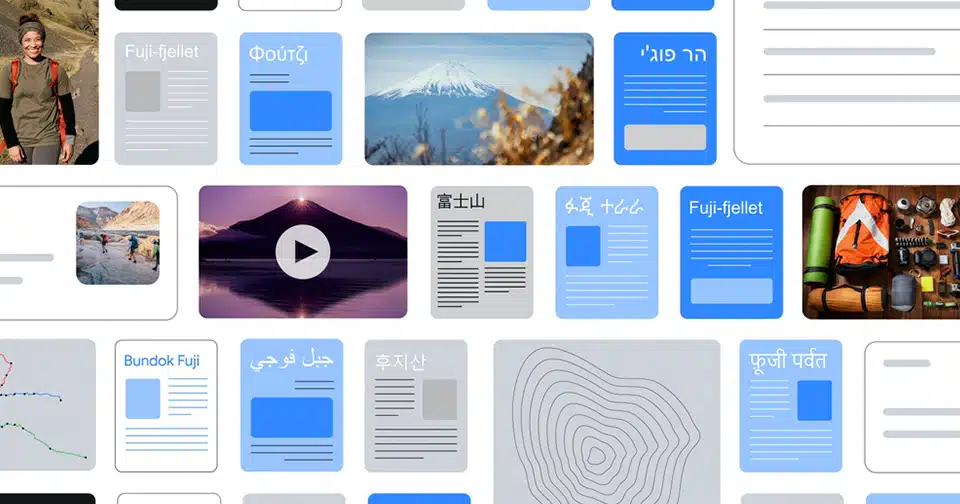

Pour y parvenir, ce modèle de langage comprend, conceptualise et génère lui-même du langage. Il supporte 75 langues et une traduction en direct. MUM comprend la requête, même si elle utilise un langage conversationnel. Ce qui démontre que le NLP (Traitement automatique du Langage Naturel) fonctionne bel et bien. Il est particulièrement utile depuis l’augmentation du nombre de recherches vocales. Il admet que les enchaînements de mots-clés utilisés lors de requêtes écrites ne correspondent pas à notre façon de parler.

MUM supporte également le cumul de plusieurs tâches simultanées. Cela signifie qu’il peut lire un texte, le comprendre et l’analyser. Il peut isoler le thème du texte et enrichir ses connaissances en puisant des informations sur le web. Les langues ne constituent plus une barrière. Il peut ensuite les traduire, produire sa propre synthèse en réponse à une requête.

Son aspect multimodal se retrouve dans sa capacité à utiliser l’information issue d’un texte ou d’une image en leur assignant des labels descriptifs. Google a repris l’exemple d’une paire de bottes de montagne en assimilant la question « Sont-elles adaptées pour escalader le mont Fuji ? ». MUM serait capable d’analyser l’image proposée et de la replacer dans le contexte posé. Il effectuerait les recherches nécessaires pour identifier si la paire de bottes est bien adaptée à une telle activité.

Comment se passera l’optimisation avec MUM ?

Avant BERT, le style de « communication » de Google reposait uniquement sur les mots-clés. Comme suite à son déploiement, le moteur de recherche était capable d’identifier le contexte des mots dans une phrase. Il a révolutionné le monde du référencement, qui se basait auparavant sur l’occurrence des mots-clés. Dorénavant, la seule manière d’améliorer le positionnement d’une page web dans les résultats de recherche est d’optimiser son contenu pour l’utilisateur. L’intégration de BERT a changé l’orientation de Google : il privilégie les pages qui répondent aux requêtes de l’utilisateur, même en l’absence de mots-clés exacts.

MUM n’est pas encore déployé, car il est en phase de test et d’amélioration. La firme de Mountain View préviendra le public lors de sa mise en place. Étant donné que MUM comprend la signification des mots, on peut toutefois s’attendre à d’autres révolutions. Il analyse les schémas récurrents dans les textes, les liens, les images et les vidéos en relations aux requêtes complexes de Google. Étant un modèle de langage naturel, MUM saisit le sens et la relation entre les mots, et ce, dans 75 langues. Il est alors capable de les traduire et de les cartographier pour fournir une réponse experte.

Les pages web dans les résultats des moteurs de recherche (SERP) ne prendraient pas la forme d’une liste de liens menant à plusieurs sites web. Grâce à MUM, Google offrirait directement une réponse basée sur les différentes informations recueillies sur Internet. Le moteur de recherche souhaite ainsi réduire le nombre de requêtes effectuées par une personne pour accéder à l’information recherchée. Le déploiement de MUM permettrait ainsi de fournir une réponse cohérente et simplifiée.

Étant donné que les mots-clés n’auraient plus la même importance, de nombreux experts en SEO se demandent si ce nouvel algorithme de Google rendrait le référencement naturel obsolète. Les internautes ne chercheraient plus uniquement des pages à consulter : lorsqu’un utilisateur enverrait une requête à MUM, ce dernier répondrait tel un assistant personnel. Google transcenderait son statut de moteur de recherche pour devenir en quelque sorte un système de présentation de l’information.

Qu’en est-il des mots-clés ? Ils restent importants, étant donné que les recherches sont basées sur des mots. Par contre, ils ne pourront plus être utilisés pour améliorer le positionnement d’une page web de la manière actuelle. Il faut assimiler que dans son fonctionnement, l’algorithme de Google se rapproche de plus en plus de la lecture et de la compréhension humaine.

Comme pour BERT, il sera impossible de tromper MUM en termes d’optimisation. La meilleure stratégie restera de produire du contenu utile qui répondra aux besoins et aux interrogations de l’audience. Il doit répondre aux critères E.A.T. de Google – Expertise, Autorité, Confiance. La rédaction ne se fera plus pour satisfaire les algorithmes, mais mettra l’expérience utilisateur en priorité. Un contenu structuré sera également plus facile à comprendre et à recommander par le moteur de recherche.